ABテストの正しいやり方|設計・実行・分析の全手順と失敗しないコツ

「ABテストを実施しているのに、なぜか成果につながらない」「どこまでの差があれば勝ちパターンと言えるのか判断できない」——こうした悩みを抱えるマーケティング担当者は少なくありません。ABテストは正しく設計・実行・分析すれば、広告やLPの改善に直結する強力な手法です。しかし、手順を誤ると間違った結論を導き、かえって成果を悪化させるリスクもあります。本記事では、ABテストの基本から設計・実行・分析の全手順、そして現場で起こりがちな失敗パターンとその対策まで体系的に解説します。

ABテストとは、Webページや広告クリエイティブなどの要素について、2つ以上のバリエーション(パターンA・パターンB)をランダムにユーザーに表示し、どちらがより高い成果を生むかをデータで検証する手法です。「スプリットテスト」とも呼ばれます。

ABテストの最大の価値は、意思決定を「勘や経験」から「データに基づく根拠」へ転換できる点にあります。たとえば、CTAボタンの色を赤にするか青にするかという議論は、社内で延々と続きがちです。ABテストを使えば、実際のユーザー行動データをもとに、どちらがコンバージョン率を高めるかを客観的に判断できます。

ABテストの対象は幅広く、LP(ランディングページ)のヘッドコピーやCTAボタン、広告のクリエイティブやコピー、メールの件名や本文レイアウト、Webサイトのナビゲーション構造やフォーム設計など、ユーザーの行動に影響を与えるあらゆる要素がテスト対象になります。

ABテストの成否は、実行前の設計段階で8割が決まります。「とりあえずテストしてみよう」ではなく、仮説の設定から評価指標の定義、サンプルサイズの計算までを事前に詰めておくことが、信頼性の高い結果を得る大前提です。

ABテストの出発点は、明確な仮説を立てることです。仮説は「何を」「どう変えれば」「どの指標が」「どの程度改善するか」を具体的に言語化したものです。

良い仮説の例は「LP上部のCTAコピーを機能訴求から便益訴求に変更すると、CVRが現状の2.1%から2.8%に改善する。理由は、ユーザー調査で"自分にとってのメリットが分かりにくい"という声が多かったため」というものです。一方、悪い仮説の例は「ボタンの色を変えれば何か良くなるかもしれない」のような曖昧なものです。仮説がないテストは、結果が出ても次のアクションにつながりません。

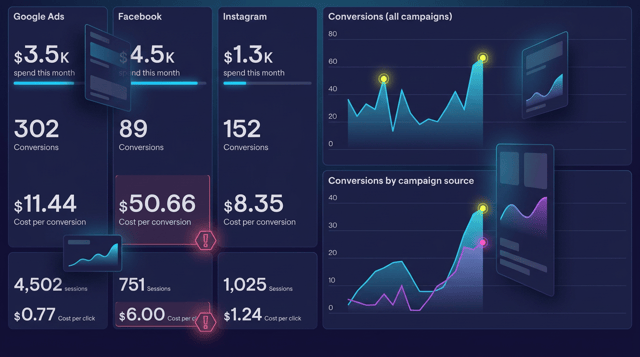

仮説を立てる際は、GA4やヒートマップツールのデータ、ユーザーアンケートの結果、カスタマーサポートへの問い合わせ内容など、定量・定性両方のインプットを活用しましょう。NeX-Rayのダッシュボードで広告やGA4のデータを横断的に確認すれば、どのページのどの段階でユーザーが離脱しているかを素早く特定でき、優先度の高いテスト仮説を効率的に見つけることができます。

テストの成否を判断する評価指標を事前に決めておきます。最も重要な指標を「主要評価指標(プライマリKPI)」とし、補助的に確認する指標を「副次評価指標(セカンダリKPI)」として区別します。

たとえば、LPのCTAボタンを変更するテストの場合、プライマリKPIはCVR(コンバージョン率)、セカンダリKPIはCTAのクリック率やフォーム到達率、直帰率などになります。プライマリKPIは1つに絞ることが鉄則です。複数の指標で同時に勝ち負けを判断しようとすると、統計的な誤りを犯すリスクが高まります。

ABテストで信頼できる結論を出すには、十分なサンプルサイズ(テストに参加するユーザー数)が必要です。サンプルサイズの計算には、現在のCVR(ベースライン)、検出したい改善幅(最小検出可能効果:MDE)、統計的有意水準(通常5%)、検出力(通常80%)の4つのパラメータが必要です。

たとえば、現在のCVRが3%で、これを3.6%に改善したい(相対改善20%)場合、有意水準5%・検出力80%の条件で、各パターンに約7,500ユーザーが必要です。1日のLP訪問者数が500人であれば、テスト期間は最低でも30日間必要ということになります。

サンプルサイズの計算を省略すると、データ不足のまま結論を出してしまい、たまたまの偏り(統計的ノイズ)を実力差と誤認するリスクがあります。これはABテストにおける最も危険な失敗パターンの一つです。

テスト設計書には、テスト名、仮説、変更内容(コントロール群とテスト群の違い)、プライマリKPIとセカンダリKPI、対象ページURL、対象セグメント、必要サンプルサイズ、想定テスト期間、判定基準を記載します。テスト設計書を関係者で共有・合意しておくことで、テスト途中での指標の後出し変更や、結果の恣意的な解釈を防ぐことができます。

テストツール(Google Optimize後継のサードパーティツールやVWO、Optimizelyなど)を使い、コントロール群(現行パターン)とテスト群(改善パターン)にトラフィックを均等に配分します。配分比率は原則50:50が基本です。テスト群を10%にして様子を見る、といったアプローチは、サンプルサイズの確保に時間がかかりすぎるため推奨しません。

重要なのは、ユーザーの振り分けがランダムかつ一貫性を保つことです。同一ユーザーがセッションごとに異なるパターンを見てしまうと、テストの信頼性が損なわれます。CookieやユーザーIDベースで振り分けを固定する仕組みが必要です。

テスト期間は、事前に計算したサンプルサイズを確保できる日数を基準に設定します。ただし、最低でも1週間(7日間)はテストを走らせましょう。曜日ごとのユーザー行動の違い(平日と週末など)を含めないと、結果が特定の曜日に偏るリスクがあるためです。

逆に、テスト期間が長すぎるのもリスクです。市場環境や季節要因の変化がテスト結果にノイズとして混入する可能性があるため、一般的には2週間から4週間を目安とします。サンプルサイズが十分に集まらない場合は、テスト対象の変更幅(MDE)を大きくするか、トラフィックの多いページでテストすることを検討してください。

ABテストの実行中には、守るべきルールがあります。まず、テスト途中で結果を見て早期に停止しないことです。これは「ピーキング問題」と呼ばれ、統計的に有意な差が出る前にテストを止めると、偽陽性(本当は差がないのに差があると判断してしまう)の確率が大幅に上がります。

また、テスト期間中にテスト対象ページの別の要素を変更してはいけません。テスト群のCTAボタンを変えているのに、途中でページ全体のデザインを変更してしまうと、CTAの効果なのかデザイン変更の効果なのか判別できなくなります。同様に、テスト期間中に大規模なキャンペーンやセールを実施すると、通常とは異なるユーザー層が流入し、テスト結果が歪む可能性があります。

ABテストの分析で最も重要な概念が「統計的有意差」です。テスト群とコントロール群のCVRに差が出たとしても、その差が偶然(サンプリングの偏り)によるものなのか、本当にパターンの違いによるものなのかを判断する必要があります。

p値(p-value)は「もし本当はAとBに差がなかった場合に、今回観測されたデータ以上の差が偶然発生する確率」を表します。一般的にp値が0.05(5%)未満であれば「統計的に有意な差がある」と判断します。ただし、p値が0.05を少し上回る場合でも「差がない」と断定するのは早計です。サンプルサイズを増やせば有意になる可能性もあるため、効果量(実際の改善幅)も合わせて確認しましょう。

p値だけでなく、95%信頼区間も確認することを推奨します。信頼区間は「真の効果がどの範囲にある可能性が高いか」を示します。たとえば、「CVRの改善幅は+0.3%〜+1.2%(95%信頼区間)」という結果であれば、最低でも+0.3%の改善は見込めると判断できます。信頼区間が0をまたぐ場合(たとえば-0.2%〜+0.8%)は、改善効果があるかどうか確定的なことは言えません。

全体の結果だけでなく、デバイス別(PC/スマートフォン)、流入元別(広告/オーガニック/SNS)、新規/リピーター別などのセグメントに分けて結果を確認することも重要です。全体ではBパターンが勝っていても、スマートフォンユーザーに限ればAパターンの方が良い結果を出しているケースは珍しくありません。

NeX-Rayでは、GA4のデータに加えて広告媒体別やSNS流入のデータを横断的に確認できるため、ABテスト結果をチャネル別に深掘りする際にも活用できます。特に広告経由のユーザーとオーガニック経由のユーザーでは行動パターンが異なることが多いため、流入チャネル別の分析は必ず行いましょう。

最も多い失敗パターンです。数百ユーザーのデータだけで「Bが勝った」と判断してしまうケースが後を絶ちません。CVRが数%の世界では、数百サンプルの差は容易にランダムなばらつきの範囲内です。必ず事前にサンプルサイズを計算し、その数に到達するまでテストを継続してください。

CTAのコピー、ボタンの色、ファーストビューの画像を一度に全部変えてしまうパターンです。結果が出ても、どの要素が改善に寄与したのかが分からないため、次の改善に活かせません。1回のテストでは変更要素を1つに絞り、他の条件を揃えることが原則です。複数要素を同時にテストしたい場合は多変量テスト(MVT)の手法を使いますが、必要なサンプルサイズが大幅に増えるため、トラフィックの少ないサイトでは現実的ではないことが多いです。

テスト開始から数日で「有意差が出た」と判断し、テストを早期終了するパターンです。データが少ない段階ではp値が大きく変動しやすく、たまたま有意差が出ているように見えるだけのことがあります。これを繰り返すと、実際には効果のない変更を「改善」として採用してしまう確率が高まります。事前に定めたサンプルサイズとテスト期間を遵守しましょう。どうしても早期判断が必要な場合は、逐次検定(シーケンシャルテスト)の手法を検討してください。

「とりあえずいろいろ試してみよう」というアプローチは、時間とトラフィックの浪費になりがちです。ABテストは1回のテストに数週間かかるため、年間で実施できるテスト回数には限りがあります。データや顧客インサイトに基づいた優先度の高い仮説から順にテストを実行し、テスト結果は次の仮説に必ずフィードバックする「学習ループ」を回すことが重要です。

ABテストで勝ったパターンを全トラフィックに適用した後、テスト時ほどの改善効果が出ないことがあります。これは「回帰効果」と呼ばれ、テスト期間中の結果がやや上振れしていた可能性を示します。勝ちパターンを本適用した後も、しばらくは実際のCVRを追跡し、テスト時の結果と乖離がないかを確認する習慣をつけましょう。

LPはABテストの最も代表的な適用領域です。テスト対象として優先度が高いのは、ファーストビューのキャッチコピー、CTAボタンの文言と配置、フォームの項目数と構成、社会的証明(導入企業ロゴ、実績数字、口コミ)の有無と配置、ページの長さ(ロングLP vs ショートLP)などです。特にファーストビューは離脱率への影響が大きいため、最初にテストすべき領域です。

Google広告やMeta広告では、広告プラットフォーム自体にABテスト機能が組み込まれています。広告見出し、説明文、画像や動画のクリエイティブ、ターゲティング設定など、テスト可能な要素は多岐にわたります。広告のABテストでは、CTR(クリック率)だけでなく、最終的なCVRやCPAまでを評価指標に含めることが重要です。クリック率が高くてもコンバージョンにつながらない広告は、むしろCPAを悪化させます。NeX-Rayで広告データとGA4のコンバージョンデータを統合すれば、広告クリックからコンバージョンまでの一気通貫の分析が可能になります。

メールのABテストは、件名、送信時間、本文のレイアウト、CTAの文言と位置などが主なテスト対象です。メール配信ツールの多くにはABテスト機能が標準搭載されており、リストの一部(たとえば20%)にテストを実施し、勝ちパターンを残りの80%に自動送信する仕組みも利用できます。件名のテストは開封率に直結するため、最も手軽かつ効果的なテストの入り口です。

ここまでの内容を踏まえ、ABテストを成功に導くための実践的なコツを5つに整理します。

第一に、テスト前にサンプルサイズとテスト期間を必ず計算し、テスト設計書として文書化することです。これにより、テスト途中での恣意的な判断を防げます。

第二に、テストの優先順位をインパクト×実行容易性で決めることです。CVRへの影響が大きく、かつ実装が容易な変更から着手すれば、短期間で大きな成果を得やすくなります。

第三に、テスト結果をナレッジとして蓄積・共有することです。テスト結果(成功・失敗を問わず)を社内のナレッジベースに記録し、チーム全体で学習を共有する仕組みを作りましょう。過去のテスト結果は、新しい仮説を立てる際の貴重なインプットになります。

第四に、マイクロコンバージョンも活用することです。最終的なコンバージョン(購入や問い合わせ)だけをKPIにすると、必要なサンプルサイズが膨大になりがちです。CTAクリック、フォーム到達、カート追加といったマイクロコンバージョンをKPIにすることで、少ないトラフィックでもテストを回しやすくなります。

第五に、テストの結果を次のアクションに必ずつなげることです。テストはそれ自体が目的ではなく、改善サイクルを回すための手段です。勝ちパターンの本適用、負けパターンの原因分析、そして次の仮説の立案までを一連のプロセスとして設計しましょう。

ABテストツールを選ぶ際には、テストの設定・実装のしやすさ、統計エンジンの信頼性(頻度主義かベイジアンか)、GA4や広告プラットフォームとの連携性、セグメント機能の柔軟性、価格体系の5つの観点で比較しましょう。

代表的なABテストツールとしては、VWO(Visual Website Optimizer)、Optimizely、AB Tasty、Google広告のテスト機能などがあります。小規模サイトであれば、Googleタグマネージャーとカスタムイベントを活用して簡易的なABテストを実施する方法もあります。

どのツールを使う場合でも、テスト結果の分析にはGA4のデータと組み合わせることが重要です。テストツール単体ではクリックやCVRしか見えませんが、GA4のデータと統合すれば、テスト群ごとの滞在時間や回遊パターン、マイクロコンバージョンの推移まで深掘りできます。NeX-Rayを活用すれば、GA4データと広告データを一元管理したうえで、ABテスト前後の変化をダッシュボードで可視化できます。

ABテストは、マーケティング施策の改善を「勘」ではなく「データ」で行うための最も基本的かつ強力な手法です。ただし、正しい設計なしに実行すると、間違った結論を導くリスクがあります。本記事で紹介した手順をまとめると、次のようになります。

設計段階では、データに基づいた仮説を立て、プライマリKPIを1つに絞り、必要なサンプルサイズを事前に計算します。実行段階では、50:50のランダム配分を維持し、テスト期間を遵守し、途中で結果を見て早期停止しないことが鉄則です。分析段階では、p値と信頼区間の両方を確認し、セグメント別の深掘り分析を行い、結果を次のアクションにつなげます。

ABテストの精度を上げるためには、テスト結果の分析にとどまらず、広告やSNS、GA4のデータを横断的に確認できる環境が重要です。NeX-Rayのような統合ダッシュボードを活用すれば、テスト仮説の発見から結果の検証、さらには全チャネルへの改善展開まで、データドリブンな改善サイクルを効率的に回すことができます。まずは自社の最も重要なページでひとつテストを始めてみてください。小さな改善の積み重ねが、大きな成果の差を生み出します。

CRMとMAの違いを、目的・対象・データ粒度・主管部署の観点で整理し、SFAとの関係、両者を連携することで実現できる4つの価値(リード受け渡し・一貫した顧客体験・ROI評価・部門横断レポーティング)、連携設計の4ステップ、HubSpot/S...

マーケティングKPI設計の全体像を、KGI・KPI・KSFの関係整理から、KGI因数分解とファネル展開によるKPIツリーの作り方、SMART原則による指標選定、認知~ロイヤル化までの代表的KPI(リーチ・指名検索・CVR・CPA・ROAS・...

MQL(マーケティング適格リード)とSQL(営業適格リード)の違いを徹底解説。スコアリング基準の設計、SLAの作り方、マーケと営業のリード受け渡しを成功させるためのベストプラクティスを紹介します。